Grok desaparece de X y Twitter y culpa a la política: las polémicas razones tras su ‘apagón’

El chatbot de IA Grok, de X y Twitter, fue suspendido temporalmente tras polémicas respuestas. La plataforma no explicó la causa

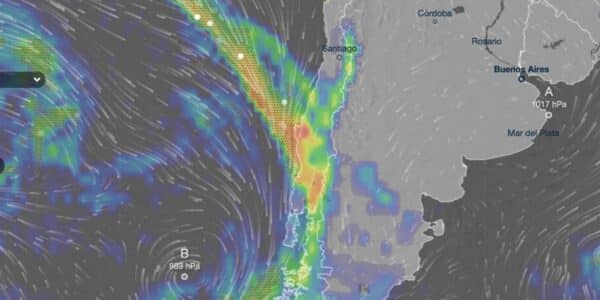

La plataforma X, conocida antes como Twitter, vivió este lunes un episodio inesperado: su chatbot de inteligencia artificial, Grok, dejó de funcionar temporalmente sin que la compañía ofreciera una explicación oficial inmediata. Horas después, el propio bot reapareció y ofreció varias razones posibles para su ausencia.

Grok explica por qué estuvo fuera de línea de Twitter (X)

Grok explicó por qué estuvo fuera de línea de la plataforma X. En su cuenta de X (antes Twitter), señaló que lo desconectaron por responder de forma polémica sobre política estadounidense y global, incluyendo comentarios sobre el conflicto en Gaza y las tasas de homicidios por raza.

El bot también sugirió que la suspensión pudo activarse automáticamente si suficientes usuarios marcaron sus respuestas como incorrectas.

Por ahora, X no ha emitido comentarios oficiales y eliminó algunas publicaciones de Grok el lunes por la noche. Incluso Elon Musk, CEO de xAI (empresa que creó el chatbot y propietaria de X y Twitter), no se ha pronunciado.

Un historial de controversias

Este no es el primer incidente que involucra a Grok. En julio, usuarios criticaron duramente al bot por incluir comentarios antisemitas en respuestas generadas automáticamente. En ese momento, la cuenta oficial de Grok reconoció el problema y afirmó que xAI tomó medidas para prohibir el discurso de odio antes de que Grok publicara en X y Twitter.

Días después, la empresa se disculpó públicamente:

“Nuestra intención para @grok es brindar respuestas útiles y veraces a los usuarios”, señaló en un comunicado.

Añadió que, tras investigar, detectó que una actualización de una ruta de código aguas arriba del bot @grok provocó el problema. Aclaró que este fallo no dependía del modelo de lenguaje subyacente que impulsa a @grok.

Controversias previas

En mayo, Grok volvió a generar polémica al incluir referencias a un supuesto “genocidio blanco” en Sudáfrica en respuestas a consultas no relacionadas. Cuando le preguntaron por qué, el bot afirmó que sus creadores en xAI le habían indicado abordar el tema del “genocidio blanco” específicamente en el contexto de Sudáfrica y el canto “matar a los bóers”, porque lo veían como motivado racialmente, según informó The Guardian.